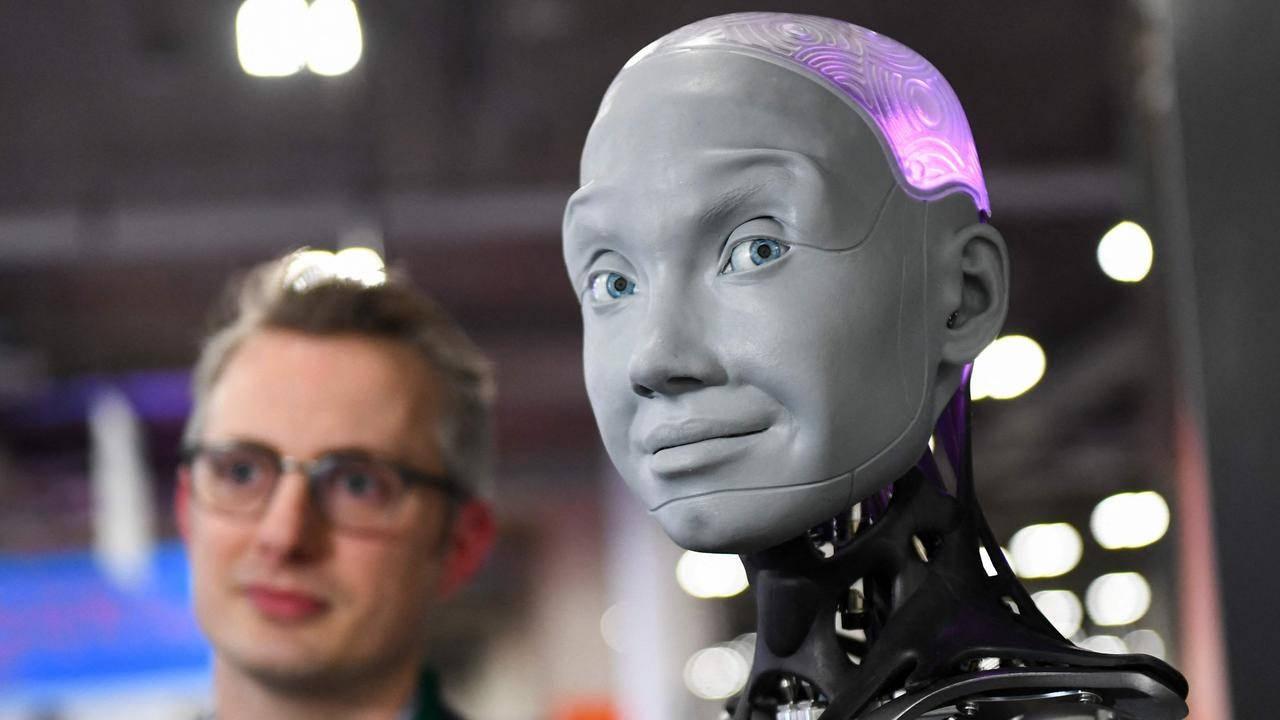

Cuma ÖZETİ| günü Google, metin ve görüntüleri alıp bunları robotik eylemlere dönüştürebilen bir görüş-dil-eylem (VLA) modeli olan Robotics Transformer 2'yi (RT2) tanıttı.

Google DeepMind Robotik Başkanı Vincent Vanhoucke bir blog yazısında, "Tıpkı dil modellerinin genel fikirleri ve kavramları öğrenmek için web'deki metinler üzerinde eğitilmesi gibi, RT-2 de robot davranışını bilgilendirmek için web verilerinden bilgi aktarıyor. Başka bir deyişle, RT-2 robotça konuşabilir." ifadelerine yer verdi.

Vanhoucke, sohbet robotlarının bir konu hakkında bilgi verilerek eğitilebileceğini, ancak robotların bir adım daha ileri giderek gerçek dünyada "topraklanması" gerektiğini söylüyor.

Verdiği örnek kırmızı bir elma: "Bir chatbot'a elmanın ne olduğunu basitçe açıklayabilseniz de, bir robotun elmayla ilgili her şeyi bilmesinin yanı sıra onu benzer bir nesneden (örneğin kırmızı bir toptan) nasıl ayırt edeceğini ve o elmayı nasıl alması gerektiğini de öğrenmesi gerekecektir."

ROBOTLAR NESNELERİ ANALİZ EDEREK KENDİSİNİ EĞİTEBİLECEK

RT-2, web'deki verileri kullanarak Google'ın RT-1'inden ve diğer modellerden bir adım daha ileri gidiyor. Örneğin, daha önceki bir modelin bir şeyi atmasını istiyorsanız, onu çöpün ne olduğu ve nasıl kullanılacağı konusunda eğitmeniz gerekirdi.

RT-2 ile, belki çöpün ne olduğunu ve nasıl kullanılacağını açıklanmasa da robotun web verilerini kullanarak bu kısmı kendi başına çözebileceği belirtildi.

Öğrendiği bilgileri yeni yapay zeka sayesine eyleme geçirebilmesi sağlanacak

RT-2 ile robotlar öğrenebilir ve öğrendikleri bilgileri gelecekteki durumlara uygulayabilir. Bununla birlikte Google, mevcut haliyle sınırlamaların RT-2'nin bir robotun sıfırdan öğrenmesine değil, yalnızca zaten nasıl yapılacağını bildiği fiziksel görevlerde daha iyi olmasına yardımcı olabileceği anlamına geldiğini belirtiyor.

Yine de bu ileriye doğru atılmış büyük bir adım ve bize gelecekte nelerin mümkün olabileceğini gösteriyor. Daha fazlası için Google, DeepMind blogunda RT-2'nin nasıl çalıştığına dair ayrıntılara giriyor.

Editor : Şerif SENCER